weqfajinaazad.org – Neural Networks (jaringan saraf tiruan) adalah fondasi utama kecerdasan buatan modern—dari ChatGPT yang menulis puisi hingga Tesla Autopilot yang mengemudi sendiri. Terinspirasi dari struktur otak manusia dengan miliaran neuron yang saling terhubung, teknologi ini memungkinkan komputer “belajar” dari data seperti bayi belajar berjalan. Pada 2025, neural networks telah mencapai milestone baru: model seperti Grok-3 dari xAI memproses 1 triliun parameter, mengalahkan batas kemampuan manusia dalam tugas visual dan bahasa. Bukan lagi fiksi ilmiah, neural networks adalah mesin prediksi paling akurat yang pernah diciptakan, dengan aplikasi dari diagnosis kanker hingga prediksi gempa bumi. Mari kita bedah cara kerja, evolusi, dan masa depannya.

Cara Kerja Neural Networks: Dari Input ke “Intuisi” Digital

Bayangkan neural network sebagai lapisan-lapisan neuron digital yang meniru sinapsis otak. Setiap “neuron” menerima input, memprosesnya melalui fungsi matematis, lalu mengirim output ke lapisan berikutnya.

Struktur Dasar (Perceptron):

Input Layer → Hidden Layers → Output Layer- Input Layer: Data mentah (gambar piksel, teks, suara).

- Hidden Layers: “Otak” jaringan—setiap neuron hitung: output = activation_function(∑(weight_i × input_i) + bias)

- Output Layer: Prediksi akhir (klasifikasi, regresi).

Pelatihan (Backpropagation): Jaringan “belajar” dari kesalahan. Algoritma Gradient Descent sesuaikan bobot (weights) agar error minimum:

Loss Function → Backward Pass → Update WeightsVisualisasi Sederhana:

Input: Gambar Kucing

Layer 1: Deteksi Garis

Layer 2: Deteksi Telinga

Layer 3: Deteksi Ekor

Output: 99% Kucing

Jenis Neural Networks: Spesialisasi untuk Setiap Masalah

| Tipe | Deskripsi | Aplikasi Unggulan |

|---|---|---|

| Feedforward (MLP) | Alur searah, dasar klasik | Klasifikasi sederhana |

| CNN (Convolutional) | Khusus gambar/video | Deteksi objek, Face ID |

| RNN/LSTM | Memori sekuensial | Prediksi teks, terjemahan |

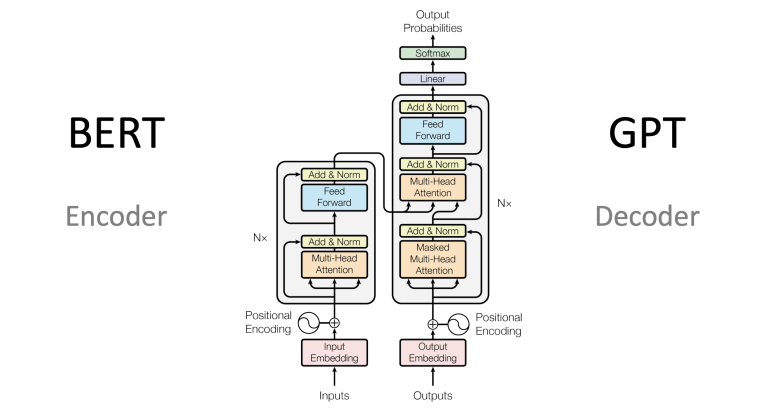

| Transformer | Attention mechanism | GPT, BERT, Grok |

| GAN (Generative) | Generator vs Diskriminator | Deepfake, DALL-E |

| Diffusion Models | “Menghapus noise” bertahap | Midjourney, Stable Diffusion |

Transformer revolusioner sejak 2017 (paper “Attention is All You Need”): Mekanisme self-attention biarkan model fokus pada kata penting dalam kalimat panjang.

Evolusi Historis: Dari 1943 ke Era Triliunan Parameter

| Tahun | Milestone | Tokoh Penting |

|---|---|---|

| 1943 | McCulloch-Pitts: Model neuron pertama | Warren McCulloch |

| 1958 | Perceptron | Frank Rosenblatt |

| 1986 | Backpropagation | Rumelhart, Hinton, Williams |

| 2012 | AlexNet menang ImageNet | Krizhevsky et al. |

| 2017 | Transformer | Vaswani et al. (Google) |

| 2025 | Grok-3 (1T params), GPT-5 | xAI, OpenAI |

Geoffrey Hinton (“Godfather of AI”) tinggalkan Google 2023, peringatkan risiko eksistensial neural networks superintelijen.

Aplikasi 2025: Neural Networks di Mana-mana

- Kesehatan: Model PathAI deteksi kanker payudara 94% akurat (vs dokter 85%).

- Otomotif: Waymo Tesla gunakan CNN+Transformer untuk Full Self-Driving.

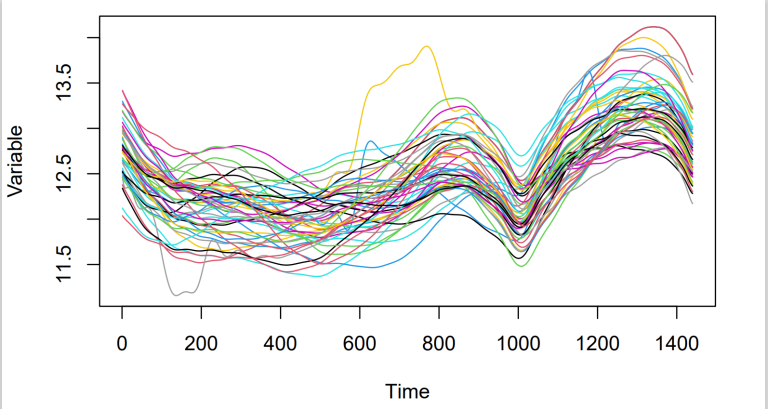

- Keuangan: Prediksi saham dengan akurasi 70%+ via LSTM.

- Kreatif: Sora (OpenAI) generate video 1080p dari teks.

- Ilmu Pengetahuan: AlphaFold3 prediksi struktur protein dalam detik.

Statistik 2025:

- 80% perusahaan Fortune 500 gunakan AI berbasis neural networks.

- Ukuran model: Dari 1 juta params (1980s) ke 1,8 triliun (GPT-4).

- Biaya training: $100 juta untuk model frontier.

Tantangan dan Masa Depan: Menuju Artificial General Intelligence (AGI)

Masalah Saat Ini:

- Data Hunger: Butuh miliaran sampel untuk akurasi tinggi.

- Compute Intensive: Training GPT-4 pakai 25.000 GPU H100.

- Black Box: Sulit pahami “mengapa” model buat keputusan.

- Energy: 1 query ChatGPT = 10x energi pencarian Google.

Solusi Horizon:

- Efficient Architectures: Mixture of Experts (MoE) seperti Grok-1.5.

- Neuromorphic Computing: Chip IBM TrueNorth tiru otak 100x efisien.

- AGI 2027-2030: xAI target “understand universe” via neural networks raksasa.

Etika & Risiko:

- Deepfake: 96% video manipulasi tak terdeteksi (2024).

- Bias: Model rasial jika data training bias.

- Superintelligence: Hinton peringatkan “AI bisa outsmart manusia”.

Dari eksperimen laboratorium 1940-an menjadi jantung AI 2025, neural networks adalah lompatan evolusi komputasi. Mereka tak hanya “belajar”—mereka memahami pola kompleks yang tak terjangkau algoritma tradisional. Saat Grok-4 dan GPT-5 dirilis, kita berdiri di ambang era di mana mesin ciptakan seni, obat, dan teori fisika. Tapi pertanyaan besar tetap: Apakah kita ciptakan asisten setia, atau penguasa baru? Jawabannya ada di tangan data scientist, etikawan, dan Anda. Selamat datang di era Neural Renaissance!